Vous avez probablement déjà utilisé LinkedIn pour chercher un emploi ou garder le contact avec vos collègues. Mais saviez-vous que LinkedIn se sert aussi de vos données pour entraîner son intelligence artificielle ?

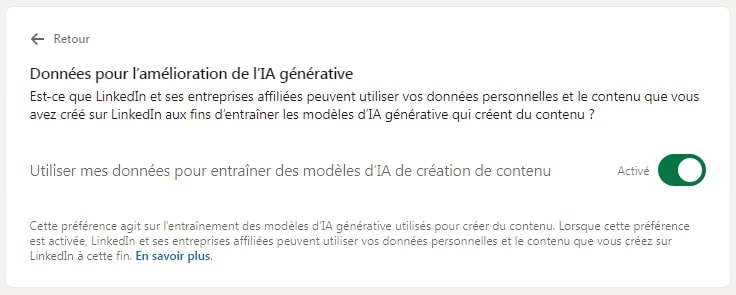

D’après un article publié par The Washington Post, LinkedIn a récemment introduit un nouveau paramètre qui a surpris pas mal d’utilisateurs. Par défaut, la plateforme utilise les informations que vous partagez pour améliorer son IA. Cela inclut vos messages, articles, et même les vidéos que vous postez. Si vous ne souhaitez pas que LinkedIn exploite vos données de cette manière, vous devez désactiver cette option manuellement.

Comment désactiver cette option ?

C’est simple : connectez-vous à votre compte LinkedIn, allez dans les « Préférences et confidentialité » via votre photo de profil, puis rendez-vous dans la section « Confidentialité des données ». Ensuite, désactivez l’option intitulée « Données pour l’amélioration de l’IA générative ».

Attention cependant, ce choix n’est pas rétroactif. Cela signifie que LinkedIn a déjà pu utiliser vos informations pour former ses modèles d’IA et qu’il est impossible de revenir en arrière.

Lire Aussi : Votre présence sur les réseaux sociaux peut vous aider à décrocher un emploi

Pourquoi LinkedIn fait-il cela ?

Greg Snapper, porte-parole de LinkedIn, explique que l’objectif est d’« aider les gens à travers le monde à accéder à de nouvelles opportunités économiques », notamment en développant des outils d’aide à la recherche d’emploi et à l’acquisition de compétences. Selon lui, ces outils peuvent aider un grand nombre de personnes à l’échelle mondiale.

Mais pour certains utilisateurs, le problème est ailleurs. LinkedIn tire profit de leurs contributions pour développer son IA, sans offrir de compensation ou même informer clairement les utilisateurs de ce processus.

Un débat en cours

Certains considèrent cela comme un échange équitable : LinkedIn vous aide à trouver un emploi, et en retour, il se sert de vos données pour améliorer ses outils. Mais d’autres se sentent mal à l’aise face à ce manque de transparence.

Mario Trujillo, avocat pour l’Electronic Frontier Foundation, souligne que rendre difficile l’accès aux options de retrait n’est pas une bonne façon de protéger la vie privée des utilisateurs. Selon lui, les entreprises devraient offrir un choix clair : un « oui » ou un « non » explicite.

Une tendance plus large

LinkedIn n’est pas la seule entreprise à utiliser les données des utilisateurs pour entraîner son IA. Des plateformes comme ChatGPT d’OpenAI ou Gemini de Google collectent également les conversations pour améliorer leurs performances, sauf si vous choisissez activement de vous retirer.

Lors d’une récente audition en Australie, Melinda Claybaugh, responsable de la confidentialité chez Meta, a révélé que l’entreprise avait exploité des contenus publics de Facebook et Instagram pour entraîner ses modèles d’IA.

LinkedIn, propriété de Microsoft, affirme avoir informé ses utilisateurs via des emails, des SMS, et des bannières sur son site. Pourtant, de nombreux utilisateurs ont découvert ce paramètre par surprise.

Lire Aussi : L’IA dans la recherche d’emploi : Comment en tirer parti ?

Comparaison avec Microsoft

En août, Microsoft a annoncé qu’elle commencerait à former son outil AI Copilot en se basant sur les interactions des utilisateurs avec celui-ci, ainsi que sur des données provenant de Bing et Microsoft Start. Mais, contrairement à LinkedIn, Microsoft a déclaré qu’elle permettrait aux utilisateurs de refuser cette collecte de données dès octobre, avant de commencer à utiliser ces informations pour former ses modèles.

Pourquoi LinkedIn n’a-t-il pas procédé de la même manière ? À cette question, Greg Snapper n’a pas donné de réponse claire, se contentant d’ajouter que LinkedIn se concentrait sur « comment mieux faire les choses à l’avenir ».